د مصنوعي ځیرکتیا په اړه عامه بحثونه په زیاتیدونکې توګه د دوو اصلي بیانیو له مخې بڼه اخلي. له یوې خوا، دا اندېښنه شته چې AI به د انسانانو ځای ونیسي او د پراخې وزګارۍ لامل به شي. له بلې خوا، یو خیالي او خوشبینانه لیدلوری دی چې AI د اقتصادي رکود څخه نیولې تر اقلیمي بدلون پورې د هر څه لپاره د حل لارې په توګه وړاندې کوي.

خو د دې بحثونو په منځ کې، موږ شاید یو بل خاموش بدلون له پامه وغورځوو. د پنټاګون او انتراپیک (Anthropic) ترمنځ کړکېچ یو مهم چانس دی چې موږ پر دې ټیکنالوژۍ خپل لیدلوری بدل کړو. مصنوعي ځیرکتیا یوازې یوه ملکي وسیله نه، بلکې یو نظامي او ستراتیژیک قدرت دی.

د مصنوعي ځیرکتیا نظامي تمرکز باندې پوهیدو لپاره، د اوسني مخابراتي ټیکنالوژیو ریښو ته کتل ګټور دي. د مشهور باور برعکس، ډیری دا ټیکنالوژۍ په پیل کې د ملکي پروژو په توګه نه وې پیل شوې. د انټرنیټ مخکښ، ARPANET، د پنټاګون له خوا د یوې دفاعي شبکې په توګه رامینځته شوی و ترڅو د اتومي برید پرمهال اړیکې خوندي وساتي. د نن ورځې مصنوعي ځیرکتیا سیسټمونه هم همدا ورته نظامي ریښې لري.

د پنټاګون او انتراپیک ترمنځ کړکېچ

د مصنوعي ځیرکتیا او دفاعي بنسټونو ترمنځ دا پخوانۍ اړیکه پدې وروستیو کې بیا راپورته شوه. د پنټاګون او انتراپیک ترمنځ کړکېچ وښودله چې د "خوندي او اخلاقي مصنوعي ځیرکتیا" په اړه د ټیکنالوژۍ سکتور شعارونه څومره کمزوري دي.

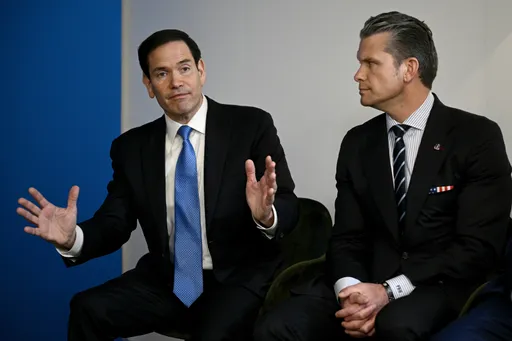

د ټرمپ ادارې او د جنګ وزیر پیټ هیګسیټ سختو نیوکو دا بحث بیا پرانیست چې ایا ټیکنالوژي واقعیا بې طرفه ده که نه. ټرمپ په خپلې ټولنیزې شبکې (Truth Social) کې دا شرکت "بنسټپال کیڼ اړخی" وباله. دا څرګندونې د واشنګټن له خوا یو سیګنال دی چې دولت پر ستراتیژیکو ټیکنالوژیو وروستی واک لري.

پدې حساس وخت کې، د سام الټمن شرکت OpenAI په چټکۍ سره هغه خلا ډکه کړه چې د دغه کړکېچ له امله رامینځته شوې وه. په داسې حال کې چې انتراپیک د اخلاقي "سرو کرښو" پر سر د حکومت له بنسټونو لرې شو، OpenAI له پنټاګون سره یو نوی شراکت پیل کړ. دا شرکت چې په ۲۰۱۵ کې د یوه غیر انتفاعي او ایډیالیسټیک لیدلوري سره جوړ شوی و، اوس د ملي امنیت د جوړښت په زړه کې ځای لري او ارزښت یې له ۷۰۰ ملیارد ډالرو اوښتی دی.

خو ترټولو مهم غبرګون د AI پلیټ فارمونو د کاروونکو له خوا و. له دغه تړون وروسته، په ټولنیزو رسنیو کې د #QuitGPT کمپاین خپور شو، چې راپورونه وايي د ChatGPT اپلیکیشن د حذف کولو کچه ۳۰۰ سلنه زیاته شوې ده.

اخلاق د شهرت د ساتلو د ډال په توګه

خو دا انځور هومره ساده نه دی څومره چې ښکاري. سره له دې چې انتراپیک پر اخلاقي بحثونو ټینګار کوي، مګر دا یو له لومړنیو شرکتونو څخه دی چې د پنټاګون په محرمو شبکو کې د کار کولو اجازه یې ترلاسه کړې. د هغوی د "کلاډ" (Claude) ماډل کارول په جنوري کې د وینزویلا د عملیاتو او په ایران کې په بریدونو کې د هدفونو په نښه کولو لپاره، د "خوندي AI" د شعارونو پولې په واضح ډول روښانه کوي.

دا چې د انتراپیک بنسټ اېښودونکی د امریکا د وګړو له څارنې سره مخالفت کوي خو په بهر کې د ډله ییزې څارنې او عملیاتي تحلیل لپاره دروازه خلاصه پریږدي، دا ښيي چې اخلاقي سرحدونه د پاسپورټونو او جغرافیایي پولو سره بدلیږي.

د ډله ییزې وژنې جوړښت

په نظامي سیسټمونو کې د مصنوعي ځیرکتیا ادغام یوازې یو ستراتیژیک امتیاز نه دی، بلکې دا د جګړې طبیعت بدلوي او د مسؤلیت په برخه کې یو لوی تشه رامینځته کوي. نن ورځ، د جګړې سیمې د ټیکنالوژۍ د لویو شرکتونو او پوځونو لپاره په لابراتوارونو بدلې شوې دي.

د دې یو ترټولو ویرونکی مثال په غزه کې د اسرائیلو له خوا کارول شوي سیستمونه لکه "حبسوره" او "لیونډر" دي. دا سیسټمونه د ملکیانو وژنه یوازې یوه "احصایوي تېروتنه" ګڼي. خبریال یووال ابراهیم استدلال کوي چې دغه ټیکنالوژۍ د جګړې ډګر د "ډله ییزې وژنې په فابریکه" بدل کړی دی. که څه هم ویل کیږي چې د انسان کنټرول شتون لري، خو په عمل کې دا یوازې یو سمبولیک تایید دی، ځکه انسان نشي کولی په څو دقیقو کې د الګوریتمونو له خوا ټاکل شوي زرګونه هدفونه وڅیړي.

د مسؤلیت ورکېدل

دا حالت مصنوعي ځیرکتیا په داسې یوې وسلې بدلوي چې مسؤلیت پکې له منځه ځي. کله چې د ناسمې ډیټا یا الګوریتمیک تعصب له امله ژوند له منځه لاړ شي، دا پوښتنه رامنځته کیږي: مسؤل څوک دی؟ هغه انجینر چې الګوریتم یې ډیزاین کړی، هغه شرکت چې سیسټم یې پلورلی، که هغه سرتیری چې د تایید تڼۍ یې فشار کړې؟

د کینګز کالج لندن د پروفیسور کینت پاین څېړنې ښيي چې د بحران په شیبو کې د انسان په پرتله د AI ماډلونو له خوا د اتومي وسلو د کارولو احتمال ۹۵ سلنه ډېر دی. بشریت تر اوسه د هیروشیما او ناګاساکي له دردوونکو یادونو څخه په زده کړې، د اتومي محرک له فشارولو ډډه کړې، خو الګوریتمونه نه دا تاریخي حافظه لري او نه اخلاقي وجدان.

الګوریتمیک محاصره

مصنوعي ځیرکتیا نور یوازې د کارونو د اسانتیا وسیله نه ده، بلکې دا د نړۍ د امنیتي جوړښت په اصلي عنصر بدل شوی. هغه محدود شرکتونه چې دا زیربناوې کنټرولوي، یوازې کوډونه نه لیکي، بلکې هغوی ډیجیټل سرحدونه جوړوي چې د افرادو او ټولنې د حرکت ساحه ټاکي.

هغه ژبې او کلتورونه چې په دغو ډیټا سیټونو کې استازولي نلري، نه یوازې له ټیکنالوژیکي تړاو، بلکې له ژور کلتوري استعمار سره هم مخ دي. AI ماډلونه د هغو کلتوري کوډونو او ایډیالوژیکي تعصبونو لېږدونکي دي چې پرې روزل شوي دي.

په وروستي تحلیل کې، مصنوعي ځیرکتیا نور یو کاري مرستیال نه دی؛ دا په یوه ډیجیټل وسله بدلیږي چې د انسان وجود او ټولنیز سرحدونه له هر لوري راګیروي.